2026.03 · 페블러스 데이터커뮤니케이션팀

읽는 시간: ~25분 · English

Executive Summary

본 포스팅은 페블러스 데이터클리닉을 이용한 ImageNet 데이터셋의 품질 진단보고서 #123에 대한 기술적·역사적 스토리입니다.

ImageNet은 딥러닝 혁명의 기폭제였습니다. 2012년 AlexNet이 이 데이터셋으로 학습해 Top-5 오류율을 26%에서 15.3%로 낮추기 전까지, 컴퓨터 비전은 정체기였습니다. 1,431,167장, 1,000개 클래스로 구성된 이 데이터셋이 없었다면 오늘의 ChatGPT도, DALL-E도 없었을 것입니다.

DataClinic 진단 결과 품질점수 60점(보통)을 기록했습니다. 클래스 균형·결측치·무결성은 양호하지만, 이미지 다양성 부족(통계 측정: 나쁨)과 고밀도 클러스터 1개가 발견됐습니다. 120가지 개 품종의 시각적 유사성, train-test 간 중복 이미지, 6%에 달하는 레이블 오류 — 딥러닝을 탄생시킨 데이터셋도 완벽하지 않았습니다.

그리고 이 발견들은 단순한 품질 보고서를 넘어, AI 데이터셋이 ImageNet에서 LLM, 그리고 Physical AI로 어떻게 진화해야 했는지를 이해하는 단서가 됩니다.

탄생 이야기 — 2006년, 프린스턴의 한 회의실

2006년, 스탠퍼드 대학의 젊은 교수 Fei-Fei Li는 동료들로부터 회의적인 시선을 받고 있었습니다. 그의 주장은 당시 AI 연구 주류와 달랐습니다. "알고리즘을 개선하는 것보다 데이터를 늘리는 것이 더 중요하다." 당시 대부분의 연구자들은 더 영리한 알고리즘을 설계하는 데 집중하고 있었으니까요.

그 시절 컴퓨터 비전 데이터셋의 현실은 초라했습니다. 가장 널리 쓰이던 PASCAL VOC는 20개 클래스에 약 10,000장, Caltech-101은 101개 클래스에 9,000장에 불과했습니다. 인간의 시각 시스템이 수십만 개의 개념을 구분하는 것을 감안하면, 이 데이터셋들로 범용 시각 인식을 달성한다는 것은 불가능에 가까웠습니다.

Fei-Fei Li의 아이디어는 단순하고 대담했습니다. WordNet의 계층적 개념 체계(~100,000개 명사 노드)를 활용해, 인터넷상의 이미지를 긁어모아 대규모 데이터셋을 구축하자는 것이었습니다. 하지만 문제는 규모였습니다. 수백만 장의 이미지 각각에 정확한 레이블을 붙이는 것은 기존 연구실 인력으로는 수십 년이 걸릴 작업이었습니다.

아마존 미케니컬 터크(Mechanical Turk)의 발견

해결책은 예상치 못한 곳에서 왔습니다. Amazon Mechanical Turk — 소액을 지불하고 사람들에게 단순 작업을 맡기는 크라우드소싱 플랫폼이었습니다. 이 플랫폼을 이용하면 전 세계 수만 명의 사람들이 동시에 이미지 레이블링 작업을 할 수 있었습니다.

Fei-Fei Li 팀은 3년에 걸쳐 다음을 완성했습니다:

- WordNet의 ~22,000개 동의어 집합(synset)에서 시각적으로 의미 있는 약 5,247개 카테고리 선정

- 인터넷에서 카테고리당 수백~수천 장의 후보 이미지 크롤링

- Mechanical Turk 작업자 167개국 약 25,000명이 이미지 검증 참여

- 총 약 320만 장의 레이블된 이미지 완성

2009년 CVPR에서 처음 발표됐을 때, ImageNet은 당시 존재하던 그 어떤 시각 데이터셋보다 100배 이상 컸습니다. 그리고 그 해, ILSVRC(ImageNet Large Scale Visual Recognition Challenge)가 시작됩니다 — 이후 AI 역사를 바꾸게 될 경연의 시작이었습니다.

📚 WordNet이란?

프린스턴 대학에서 개발한 영어 어휘 데이터베이스. 단어들을 의미 기반 네트워크로 조직화해 계층 구조를 가집니다. "개(dog)" → "포유류(mammal)" → "동물(animal)" → "생물체(organism)"처럼 상위/하위 개념이 트리 형태로 연결됩니다. ImageNet의 1,000개 클래스는 모두 WordNet의 synset(동의어 집합)에 대응합니다.

2012년 9월 30일 — 모든 것이 바뀐 날

ILSVRC 2012 결과 발표일. 토론토 대학의 대학원생 Alex Krizhevsky가 제출한 시스템의 점수가 화면에 떴을 때, 경쟁자들은 믿을 수 없었습니다.

ILSVRC Top-5 Error Rate 변화

2위 시스템: 26.2% — AlexNet은 단독으로 10%p 이상 격차를 벌렸습니다

Krizhevsky, Sutskever, Hinton이 설계한 AlexNet은 단순히 더 좋은 알고리즘이 아니었습니다. 이 모델은 세 가지 핵심 요소가 결합된 최초의 성공 사례였습니다:

- 깊은 합성곱 신경망(8개 레이어) — 당시 기준으로 매우 깊었습니다

- GPU 병렬 연산 — NVIDIA GTX 580 2장을 6일간 학습

- 대규모 데이터 — 120만 장의 ImageNet 학습 데이터

AlexNet 없이 ImageNet이 있었다면, ImageNet 없이 AlexNet이 있었다면 — 둘 중 하나만으로는 딥러닝 혁명은 일어나지 않았을 것입니다. 그 이후 역사는 빠르게 전개됩니다.

ILSVRC가 종료될 때쯤, ImageNet은 단순한 경연 도구를 넘어 딥러닝 시대의 공통 기반 언어가 되어 있었습니다. 전 세계 수천 개의 논문이 ImageNet 사전학습 모델을 기반으로 쓰였고, "ImageNet에서 사전학습된"이라는 문구는 AI 논문의 관용구가 됐습니다.

데이터셋 소개 — 1,431,167장과 1,000개의 세계

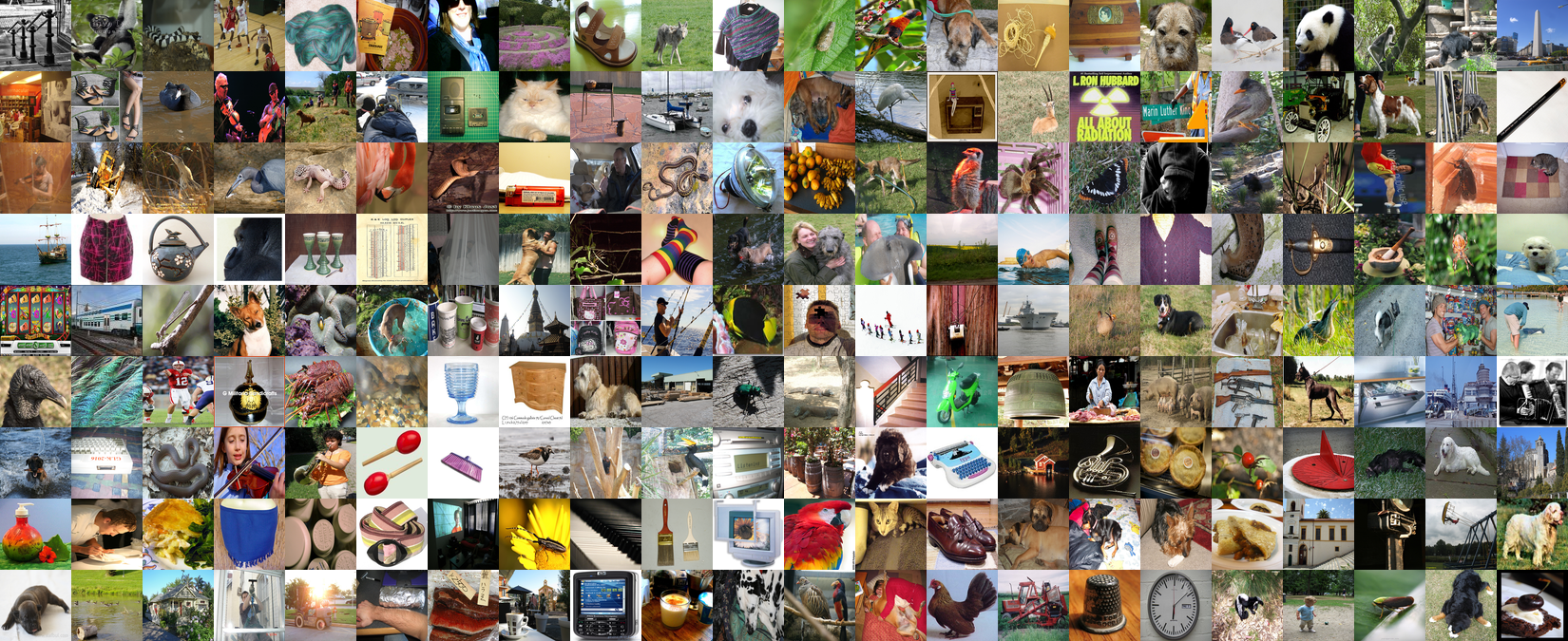

▲ ImageNet 콜라주 — 개, 고양이, 차량, 악기 등 1,000개 클래스의 이미지 모자이크

데이터 출처: image-net.org (Stanford Vision Lab) · DataClinic 리포트: #123

DataClinic이 진단한 ImageNet은 ILSVRC용 학습 데이터 1,281,167장 + 검증 데이터 50,000장 + 테스트 데이터 약 100,000장을 포함한 총 1,431,167장의 데이터셋입니다.

1,000개 클래스는 WordNet의 계층 구조를 따라 광범위한 세계를 담습니다. 동물(개, 고양이, 새, 물고기, 곤충, 파충류), 식물, 음식, 악기, 차량, 가구, 스포츠 용품, 사람이 만든 도구들까지 — 문자 그대로 세상의 단면입니다.

그 중 120개 클래스가 개(dog) 품종입니다. 포메라니안, 시베리안 허스키, 골든 리트리버, 달마시안, 불독, 치와와, 비글, 닥스훈트… 전체 클래스의 12%가 개 품종이라는 사실은 나중에 DataClinic이 발견하는 '하나의 거대한 고밀도 클러스터'의 원인이 됩니다.

(민물고기)

(금붕어)

(달마시안)

(골든 리트리버)

(호랑이)

(줄무늬 고양이)

▲ L1 클래스 평균 이미지 — 해당 클래스의 모든 이미지를 픽셀 단위로 평균한 결과. 선명도가 시각적 일관성을 나타냅니다.

(스포츠카)

(컨버터블)

(산악자전거)

(전갈)

(바나나)

(Overall Mean)

▲ 스포츠카·컨버터블 평균 이미지가 비슷하게 흐릿한 것을 주목하세요. 두 클래스의 시각적 경계가 모호합니다.

Level 1: 기초 품질 점검 — 60점의 비밀

Level 1은 픽셀 수준의 기초 체력 검사입니다. DataClinic은 네 가지를 평가합니다: 이미지 무결성, 결측치, 클래스 균형, 통계 측정.

| 평가 항목 | 등급 | 세부 내용 |

|---|---|---|

| 이미지 무결성 | ✅ 좋음 | 98.43% RGB, 1.57% Grayscale, RGBa 0.0% |

| 결측치 | ✅ 좋음 | 결측치 없음 |

| 클래스 균형 | ✅ 좋음 | 평균 1,281장, 표준편차 70.2 |

| 통계 측정 | ❌ 나쁨 | 이미지 다양성이 낮음 |

🔍 통계 측정: 나쁨 — 무슨 의미인가

전체적으로 양호한 등급들 사이에서 통계 측정만 유일하게 '나쁨'을 받았습니다. DataClinic의 통계 측정은 클래스 내 픽셀 분포의 다양성을 평가합니다. 점수가 낮다는 것은 많은 이미지들이 비슷한 색상 분포, 밝기, 구성을 가지고 있다는 의미입니다.

이 현상에는 구조적 원인이 있습니다:

- 120가지 개 품종 효과 — 12%의 클래스가 개 품종. 비슷한 조명, 배경, 포즈의 반려견 사진들이 픽셀 분포를 균질하게 만듭니다.

- 크롤링 편향 — 인터넷 이미지 크롤링은 특정 스타일(JPEG 압축, 밝은 조명, 중앙 피사체)의 사진을 과대 수집하는 경향이 있습니다.

- 시대적 한계 — 2000년대 후반 인터넷 이미지는 특정 촬영 스타일이 지배적이었습니다. 오늘날의 다양한 스마트폰 촬영 환경과는 다릅니다.

📏 해상도: 20×17px에서 7056×4488px까지

이미지 크기 범위가 극단적으로 넓습니다. 최소 20×17px은 실제로 거의 식별 불가능한 수준이고, 최대 7,056×4,488px은 고화질 DSLR 사진입니다. 이 격차는 데이터 수집 방식(인터넷 크롤링)의 특성상 불가피하지만, 학습 시 해상도 표준화(보통 224×224px)가 필수인 이유입니다.

또한 Grayscale 이미지가 1.57% 포함됩니다. 약 22,500장에 해당합니다. RGB 3채널을 가정하는 표준 모델(AlexNet, ResNet 등)은 이 이미지들을 처리할 때 별도 처리가 필요합니다.

Level 2: 특징 공간 분석 — 하나의 거대한 덩어리

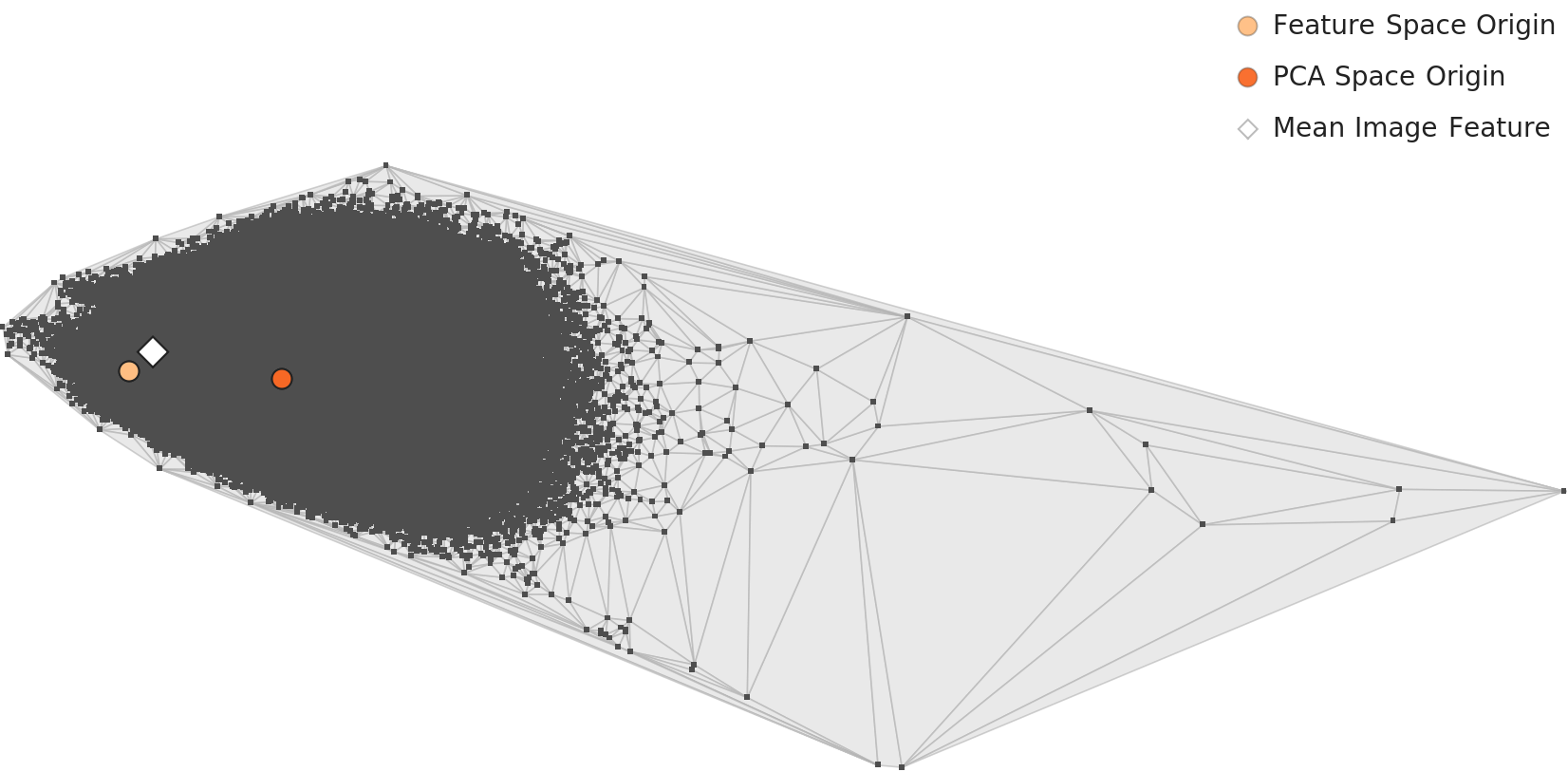

Level 2는 Wolfram ImageIdentify Net V2(1,280차원)로 전체 데이터셋의 특징 공간을 분석합니다. 1,431,167장 각각을 1,280차원 벡터로 변환해 그 분포를 관찰합니다.

🔵 핵심 발견: 고밀도 클러스터 1개

DataClinic의 가장 주목할 만한 발견은 "명확한 고밀도 클러스터가 1개 존재"한다는 것입니다. 1,000개 클래스의 데이터가 특징 공간에 고르게 분포하지 않고, 특정 영역에 극도로 밀집된 덩어리가 형성됩니다.

이 클러스터의 정체는 무엇일까요? 데이터 구성을 보면 분명해집니다. ImageNet 1,000 클래스 중 120개가 개 품종이고, 거기에 고양이, 조류, 소형 동물 등을 합치면 전체의 약 25~30%가 동물류입니다. 이 동물들의 이미지는 — 잔디밭, 실내, 소파, 마당 등 비슷한 환경에서 찍힌 비슷한 구도의 사진들로 — 범용 신경망 기준에서 서로 아주 가까운 특징 벡터를 가집니다.

▲ L2 PCA — 1,000개 클래스의 평균 특징 벡터를 2D로 투영. 우측 상단에 밀집된 클러스터가 보입니다.

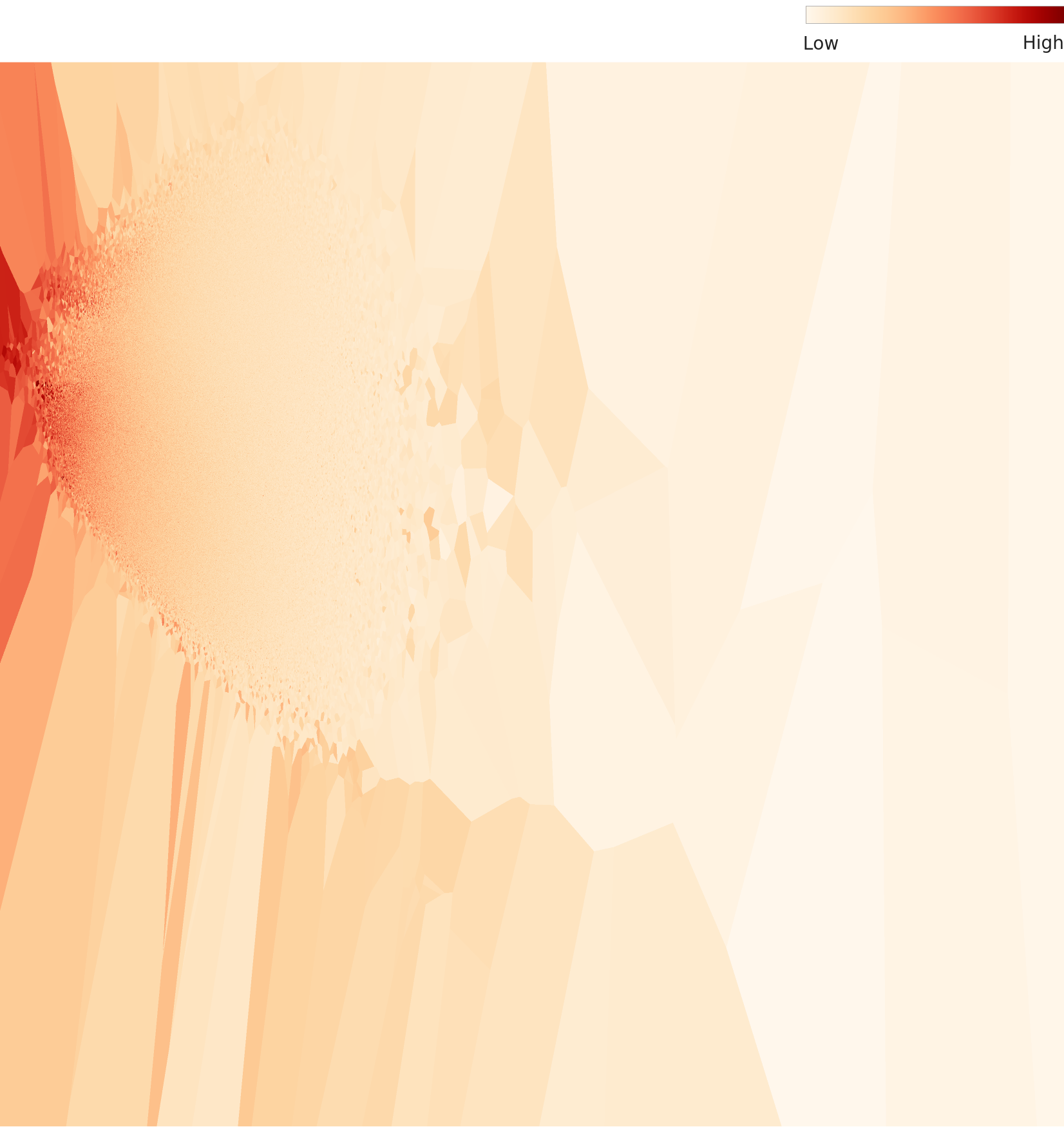

📊 전체 밀도 분포: 종형(Bell-shaped) — 그러나 편향됨

전체 밀도 분포는 종형 곡선을 유지하지만, 평균과 큰 차이를 보이는 분포가 관찰됩니다. 이는 고밀도 클러스터 때문에 분포의 꼬리(tail)가 한쪽으로 치우쳐 있음을 의미합니다. 고밀도 영역(동물 클러스터)과 저밀도 영역(희귀하고 독특한 클래스들)의 밀도 차이가 크다는 뜻입니다.

▲ L2 전체 밀도 분포. 종형을 유지하지만 평균과 큰 차이를 보이는 비대칭이 관찰됩니다.

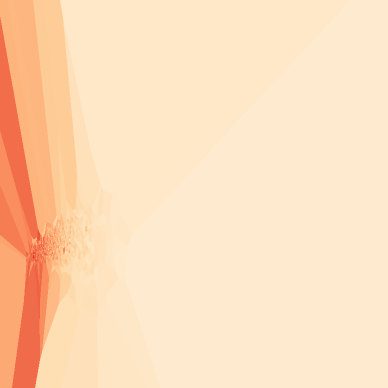

🔬 클래스별 밀도 비교

클래스별로 밀도 분포를 비교하면 극명한 차이가 나타납니다:

▲ L2 클래스별 밀도 분포. 달마시안·tench는 높은 밀도, scorpion은 낮은 밀도를 보입니다.

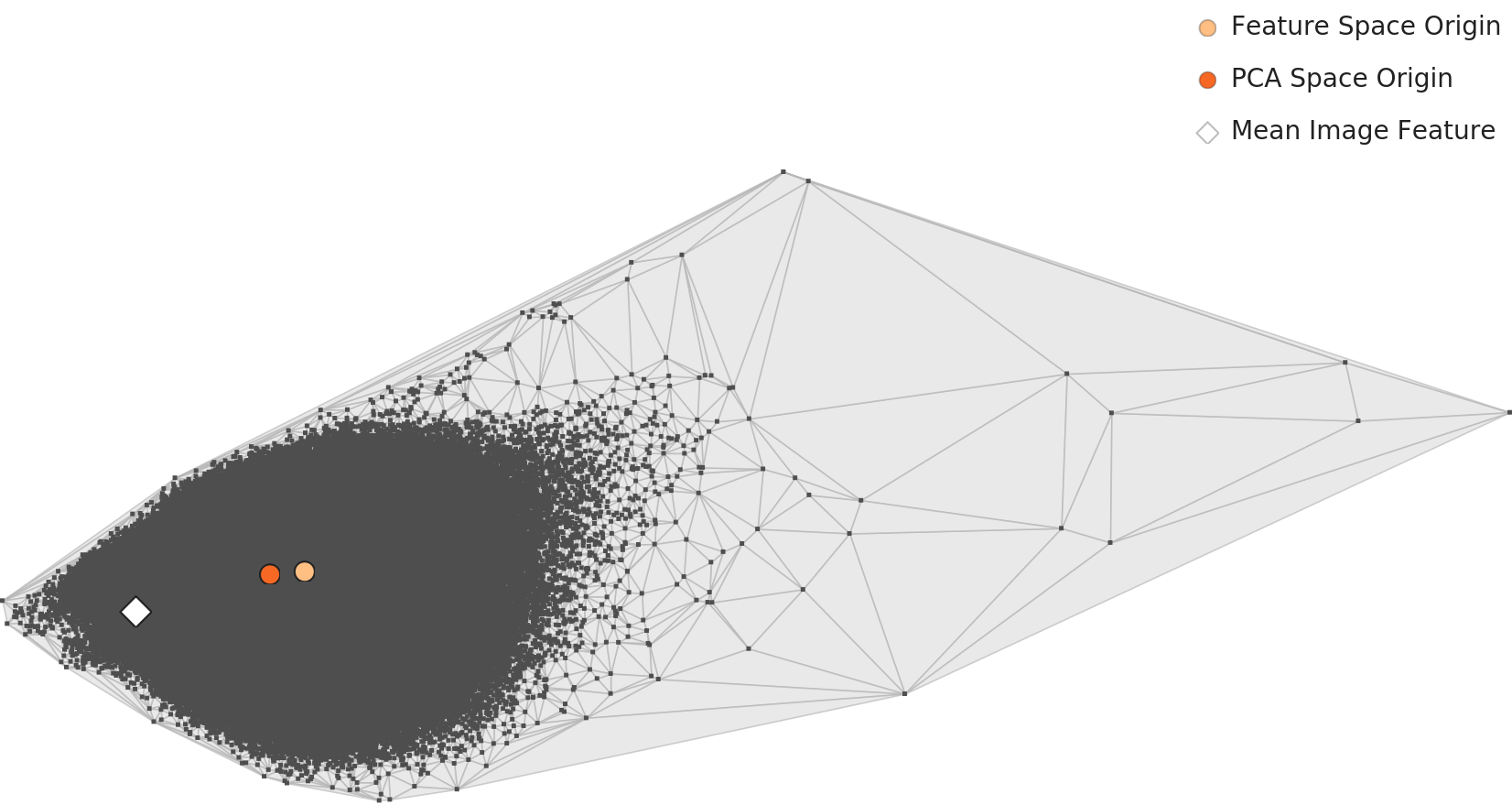

Level 3: 도메인 최적화 렌즈 — 122차원의 정밀 관찰

Level 3는 동일한 Wolfram ImageIdentify Net V2 기반에서 ImageNet 데이터셋에 최적화된 122차원 렌즈를 적용합니다. 1,280차원에서 122차원으로 줄어들면서 데이터셋 고유의 구조가 더 선명하게 드러납니다.

🎯 L3에서 보이는 것

L3 결과는 L2와 동일한 결론을 강화합니다. 고밀도 클러스터 1개가 유지되고, 아웃라이어가 관찰됩니다. 이는 중요한 시사점입니다 — ImageNet 고유의 구조적 문제(개 품종 과잉 클러스터, 유사 클래스 밀집)는 차원을 바꿔도 사라지지 않는다는 것입니다.

▲ L3 PCA (122차원). L2와 비교해 클러스터 구조가 더 선명하게 분리됩니다.

헷갈리는 클래스들 — 120가지 개 품종의 딜레마

ImageNet의 가장 유명한 설계 논쟁 중 하나는 개 품종 문제입니다. WordNet의 계층적 분류를 따라 달마시안, 시베리안 허스키, 말라뮤트, 알래스카 클리 카이 등 시각적으로 매우 유사한 120개 품종이 별개 클래스로 분리됩니다.

🐟 Tench vs. Goldfish — 물속의 쌍둥이

분류 혼동의 고전적 사례입니다. ImageNet에서 tench(잉어 계열 민물고기)는 놀랍도록 특정한 방식으로 찍혀 있습니다 — 낚시꾼이 물고기를 손에 들고 찍은 사진이 주를 이룹니다. 결과적으로 모델은 "tench"를 식별하는 게 아니라 "낚시꾼이 물고기를 들고 있는 장면"을 식별하게 됩니다.

Goldfish(금붕어)는 반대로 유리 어항 속 이미지가 지배적입니다. 두 물고기의 생물학적 차이보다 촬영 맥락(context)이 더 강한 신호가 되는 것입니다. AI가 피사체의 본질보다 배경을 학습한다는 맥락 편향(Context Bias)의 대표 사례입니다.

Tench — 낚시꾼 손 위

Goldfish — 어항 속

▲ 두 물고기의 평균 이미지 차이는 생물학적 차이보다 촬영 환경의 차이를 반영합니다.

🚗 Sports Car vs. Convertible — 날카로운 경계의 부재

컨버터블(오픈탑 스포츠카)은 스포츠카의 하위 개념입니다. 지붕이 열린 스포츠카는 컨버터블이기도 하고 스포츠카이기도 합니다. 실제로 스탠퍼드 연구팀의 분석에 따르면 ImageNet에서 sports car와 convertible은 가장 혼동 빈도가 높은 클래스 쌍 중 하나입니다. 아래 두 클래스의 평균 이미지가 거의 동일하게 보이는 것이 이를 증명합니다.

Sports Car

Convertible

▲ 두 클래스 평균 이미지가 육안으로 구별이 어렵습니다. 모델도 마찬가지입니다.

🐯 Tiger vs. Tabby Cat — 줄무늬의 함정

호랑이(Tiger)와 줄무늬 고양이(Tabby Cat)는 같은 고양잇과이며 비슷한 줄무늬 패턴을 가집니다. 이미지 크기와 배경이 다르지만, 특징 공간에서 이 두 클래스는 예상보다 가까이 위치합니다. 클로즈업된 고양이 얼굴은 호랑이와 매우 유사한 특징 벡터를 가질 수 있습니다.

📌 Fine-grained Recognition의 한계

ImageNet의 1,000 클래스 중 상당수는 Fine-grained Recognition 문제를 내포합니다. 120가지 개 품종, 다양한 고양잇과 동물, 차량 종류들... "인간도 구분하기 어려운" 경계를 AI에게 학습시킨다는 것은 고품질 레이블과 다양한 학습 데이터 없이는 근본적으로 어렵습니다. DataClinic이 발견한 '고밀도 클러스터'는 이 Fine-grained 클래스들이 특징 공간에서 과도하게 겹치는 현상의 직접적 반영입니다.

이상치 분석 — 데이터의 극단들

DataClinic은 밀도 기반 이상치 분석으로 각 클래스의 고밀도(전형적) 샘플과 저밀도(이례적) 샘플을 식별합니다. ImageNet에서 이상치는 단순한 데이터 오류가 아닌 경우가 많습니다 — 그것들은 레이블 철학의 한계를 드러내는 창문입니다.

🏆 고밀도 — 맥락이 레이블을 지배하는 클래스

고밀도 샘플, 즉 해당 클래스에서 가장 '전형적인' 이미지들은 클래스 레이블이 아닌 촬영 맥락에 의해 결정되는 경우가 많습니다:

- Tench(민물고기) — 고밀도 이미지의 대다수가 낚시꾼이 물고기를 들고 있는 장면. 물고기 자체보다 사람의 손이 더 중요한 특징이 됩니다. 이 클래스에서 어항 속 tench 사진은 오히려 '이상치'가 됩니다.

- Banana — 마트 진열대의 노란 바나나 묶음이 전형적. 나무에 달린 그린 바나나나 반쪽 잘린 바나나는 저밀도 이상치.

- Dalmatian(달마시안) — 흰 바탕에 검은 점의 서있는 달마시안 정측면 샷이 고밀도. 달마시안이 소방차 옆에 있는 사진은 — 소방차와의 문화적 연관성이 있음에도 — 이상치가 될 수 있습니다.

⚠️ 저밀도 — 가장 흥미로운 이미지들

저밀도 이상치는 두 그룹으로 나뉩니다:

① 진짜 레이블 오류 — 잘못 분류된 이미지. 한 연구(Northcutt et al., 2021)에 따르면 ImageNet 검증 세트의 약 6%가 레이블 오류를 포함합니다. 예시:

- "cardigan" 레이블에 부착된 웰시코기 개 사진 → 카디건 웰시코기(개 품종)와 카디건(옷) 혼용

- "stretcher" 레이블의 이미지 → 의료용 들것(stretcher) 대신 캔버스 틀(stretching frame)이 포함

- 다수의 피사체가 있는 이미지에서 의도된 레이블 피사체가 구석에 있는 경우

② 진짜 다양성 — 비전형적이지만 올바른 레이블. 이런 이미지들은 삭제 대상이 아니라 모델 강건성 향상의 기회입니다. DataClinic의 이상치 분석은 이 두 그룹을 수동 검토로 구분하도록 안내합니다.

🔬 DataClinic 발견: 아웃라이어의 분포 범위

L2 분석에서 밀도 범위는 고밀도 0.079~0.344, 저밀도 0.023~0.054로 관찰됩니다. 이 범위는 ImageNet이 단일 데이터셋임에도 클래스별로 극단적으로 다른 내부 응집도를 가진다는 것을 보여줍니다. Data Diet(Data 다이어트)로 고밀도 중복을 제거하고, Data Bulk-up으로 저밀도 영역을 보강하는 것이 DataClinic의 개선 권고입니다.

중복과 레이블 노이즈 — 보이지 않는 품질 위기

ImageNet의 품질 문제 중 가장 오랫동안 묻혀 있었던 두 가지 — 중복 이미지와 레이블 노이즈 — 를 DataClinic은 구조적으로 드러냅니다.

📋 Train-Test 이미지 중복 (데이터 누출)

2019년 스탠퍼드/MIT 연구팀(Recht et al.)의 분석은 충격적이었습니다. ImageNet 검증 세트(50,000장)의 이미지 중 상당수가 학습 세트에도 존재하거나, 사실상 동일한 이미지의 다른 크롭(crop)이었습니다. 이른바 '데이터 누출(Data Leakage)'입니다.

더 체계적인 연구(Barz & Denzler, 2020)는 ImageNet에서 12,195쌍의 중복(near-duplicate) 이미지를 발견했습니다. 이 중복들은:

- 동일 이미지의 서로 다른 크롭·리사이즈 버전

- 동일 피사체의 연속 촬영(burst shot)

- 미러링되거나 약간 편집된 버전

DataClinic의 Data Diet 권고는 이 중복 이미지들을 가장 직접적으로 겨냥합니다. 고밀도 클러스터 내에서 거의 동일한 이미지를 제거하면 모델이 더 다양한 패턴을 학습합니다.

🏷️ 레이블 노이즈: 6%의 오류

Cornell AI Lab의 Northcutt et al.(2021) 연구는 ImageNet 검증 세트에서 약 6%의 레이블 오류를 발견했습니다. 50,000장 검증 세트 기준 약 3,000장입니다. 주요 오류 유형:

- 다중 레이블 문제 — 이미지에 여러 물체가 있을 때 '어느 것이 정답인가'의 문제. 개 + 프리스비 이미지에서 "Labrador Retriever"와 "Frisbee" 중 하나만 정답이 될 수 없습니다.

- 계층 레이블 모호성 — "Persian cat(페르시아 고양이)"과 "tabby(줄무늬 고양이)"는 동시에 성립할 수 있습니다. 페르시아 고양이 중 줄무늬 패턴을 가진 개체가 있으니까요.

- WordNet 불일치 — "cardigan"이 'cardigan Welsh corgi(개 품종)'와 'cardigan(니트 상의)' 두 가지 의미를 가져 혼용이 발생합니다.

💡 레이블 노이즈의 역설

흥미롭게도, 6%의 레이블 오류가 있는 ImageNet으로 학습한 ResNet은 97%+의 정확도를 달성했습니다. 이것이 딥러닝의 놀라운 특성 중 하나입니다 — 충분한 규모의 데이터가 있다면 어느 정도의 레이블 노이즈는 학습 중 자연스럽게 평균화됩니다. 하지만 이것이 레이블 품질을 소홀히 해도 된다는 의미는 아닙니다. 소규모 도메인 특화 데이터셋에서 레이블 노이즈는 치명적입니다.

AI 데이터의 진화 — ImageNet에서 Physical AI까지

ImageNet은 2009년에 당대 최대 규모였습니다. 2026년의 기준으로 보면 상대적으로 작은 데이터셋입니다. AI 데이터셋은 어떻게 진화했을까요?

🔮 패러다임 전환이 말하는 것

ImageNet에서 Physical AI 데이터까지의 여정은 세 가지 근본적인 변화를 보여줍니다:

① 레이블의 해방 — 수작업 레이블(ImageNet) → 약한 레이블 → 자기지도학습. AI가 레이블 없이도 의미를 학습하는 방향으로 진화했습니다. 그러나 LLM 시대에도 고품질 큐레이션 데이터(RLHF를 위한 인간 피드백)의 가치는 오히려 높아졌습니다.

② 닫힌 세계에서 열린 세계로 — ImageNet의 1,000 클래스는 '닫힌 세계(Closed World)' 가정입니다. GPT-4V는 클래스 목록 없이 어떤 이미지도 설명합니다. 데이터셋의 경계가 사라졌습니다.

③ 디지털에서 물리적 상호작용으로 — Physical AI는 ImageNet이 풀지 못한 문제에 직면합니다. 로봇이 물체를 집는 데이터는 카메라로만 수집할 수 없습니다. 힘, 저항, 표면 질감 같은 촉각 정보가 필요합니다. 다음 10년의 데이터 품질 문제는 ImageNet과 전혀 다른 차원에 있습니다.

📐 DataClinic의 역할: 어느 시대에도 필요한 것

데이터셋이 아무리 진화해도, 데이터 품질 진단의 필요성은 사라지지 않습니다. ImageNet의 6% 레이블 오류, 고밀도 클러스터, train-test 중복 — 이것들은 2009년에도 문제였고, LAION-5B의 NSFW 콘텐츠 혼재, LLM 학습 데이터의 편향, Physical AI 데이터의 수집 분포 불균형도 동일한 본질의 문제입니다. 도구는 달라지지만 질문은 같습니다: "내 데이터에는 어떤 문제가 있는가?"

결론 — 불완전한 데이터셋이 완벽한 혁명을 만들다

DataClinic은 ImageNet에 60점(보통)을 줬습니다. 딥러닝 혁명을 촉발한 데이터셋에게 이 점수는 가혹하게 느껴질 수 있습니다. 하지만 이것이야말로 DataClinic의 핵심 가치입니다 — 역사적 위상이 아닌, 데이터 품질 기준으로만 평가합니다.

사실 60점은 일종의 역설입니다. ImageNet의 품질 문제들 — 통계 다양성 부족, 고밀도 클러스터, 중복 이미지, 6% 레이블 노이즈 — 은 이 데이터셋이 너무 잘 작동했다는 증거이기도 합니다. 알고리즘과 GPU가 발전하면서 데이터셋의 한계가 비로소 가시화된 것입니다.

📊 진단 결과 한눈에

| 항목 | 결과 | 핵심 시사점 |

|---|---|---|

| 종합 점수 | 60점 (보통) | 역사적 위상과 무관한 객관적 품질 평가 |

| L1 통계 | 나쁨 | 이미지 다양성 부족 — 개 품종 클러스터 효과 |

| 고밀도 클러스터 | 1개 | 120개 개 품종 + 유사 동물류 밀집 |

| 레이블 노이즈 | ~6% | 대규모 크라우드소싱의 불가피한 결과 |

| 개선 방향 | Diet + Bulk-up | 고밀도 중복 제거 + 저밀도 영역 보강 |

더 많은 데이터셋 품질 진단과 DataClinic 활용법은 dataclinic.ai에서 확인하세요.